一夜爆火的Kimi到底好用吗?用NAS部署kimi-free-api实际体验下

一夜爆火的Kimi到底好用吗?用NAS部署kimi-free-api实际体验下

这几天被各种kimi的文章刷屏,于是便去了解了一下kimi到底是什么。总的来说就是一个国产的智能大模型,拥有超大“内存”可以一口气读完二十万字的小说,同时它还具备联网搜索功能,可以根据你发的内容网上搜索答案并总结。几天时间官方服务器就被大量的用户使用给整宕机了,这样的热度作为一个关注科技发展的博主,自然也是要追一追的。

使用体验

首先说明,kimi官方并没有公开提供api服务,目前还是需要注册使用,但网上已经有项目可以获取到API了。这里我通过搭建kimi-free-api获取API以及接口,再将接口和模型接入到之前部署的Chat Nio项目中,从而实现自部署kimi的作用。

对话展示

对话展示根据对话展示可以看到,kimi拥有理解并回答各种问题、阅读和分析文件能力、解析网页内容能力、搜索信息能力以及中英文双语对话能力。

对话能力

对话能力智能助手的能力我就不多展示了,其实kimi最重要的就是可以根据文件和网址来分析总结内容,也能根据你的问题来给到一些合理性的建议,虽说建议都比较理想化,但好在回答都不会抽风,不会出现答非所问或者很奇怪的回答。

再展示一下自己

再展示一下自己部署过程

部署设备为极空间的Z423,毕竟我这里老设备的内存已经占用过高了,而Z423的出厂既有32G,如此大的内存不用来折腾点东西岂不是浪费性能?后续能用极空间部署的,都会优先考虑Z423了,也算是充分发挥设备性能优势。

32G大内存

32G大内存直接打开Docker仓库界面搜索:kimi-free-api下载镜像,镜像并不大,部署好也就200多M。(需要注意的事,该项目目前仅用于自用)

镜像下载

镜像下载下载之后我们直接创建容器,这里只需要将端口8000映射出去就可以了。

端口映射

端口映射由于项目只提供了接口,所以我们还需要自己去获取key。登录kimi的官网,注册登录账号之后随便发起一段对话。

kimi官网

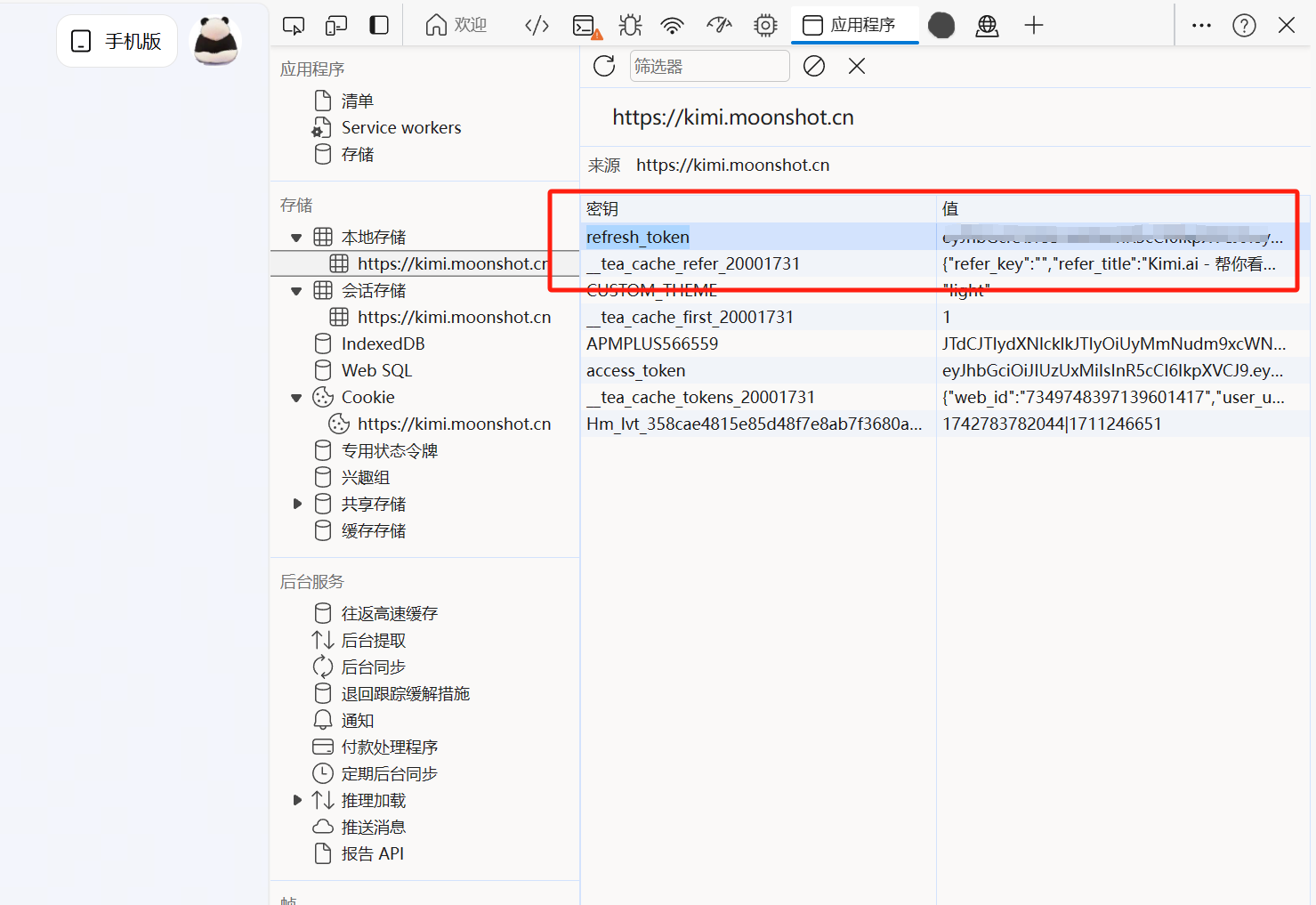

kimi官网随后按F12打开浏览器的开发人员功能,这里我使用的为Edge浏览器,所以点击应用程序-本地会话功能,找到refresh_token这一项,将其中的值记录下来,这就是稍后需要使用到的key。如果你是谷歌或其他浏览器,开发选项为英文界面,那么就在Application > Local Storage中去找。

key

key目前kimi限制普通账号每3小时内只能进行30轮长文本的问答,你可以通过提供多个账号的refresh_token来解决。

Chat Nio

Chat Nio接下来就是接入自部署的各种webGPT服务了,kimi目前是兼容openai的,所以基本上大部分GPT的web项目都可以接入kimi。这里我采用的事Chat Nio,该项目具备多模型以及自定义模型的功能,同时界面也做的很不错,详细的内容可以看看往期内容。

新建模型

新建模型不管是那个web项目,我们只需要在接入网址中填入我们刚刚部署的kimi接口地址即可,例如我这里极空间的ip为192.168.101.15端口为8700,那么在接入地址中就填写192.168.101.15:8700即可。秘钥或者key就是刚刚我们通过浏览器获取的值,很长一串。

设置

设置此时我们再进行问答,便是使用的kimi的服务了。同时在极空间容器日志中也能看到对话的内容。

日志

日志写在最后

kimi能在短时间内获得如此的热度,还是有原因的。一个是免费试用吸引了很多人,再一个就是本身模型够大,同时响应速度极快,还具备很多扩展出的功能,几乎是国内用户的GPT4.0平替了,有需求的可以去官方使用。

以上便是本期的全部内容了,如果你觉得还算有趣或者对你有所帮助,不妨点赞收藏,最后也希望能得到你的关注,咱们下期见! 三连

三连